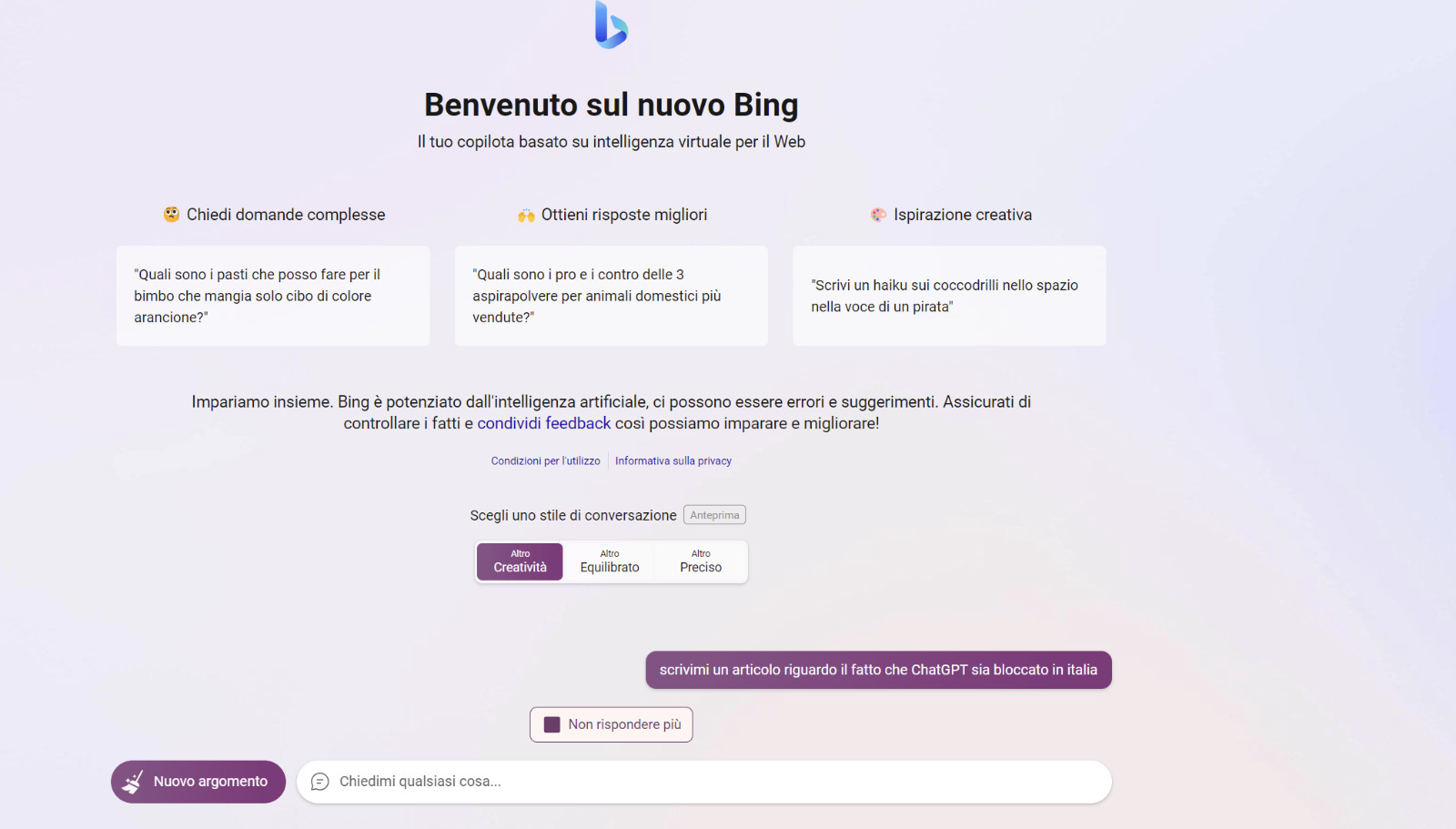

Il nuovo Bing favorito motore di ricerca è in grado di realizzare articoli basati sull’intelligenza artificiale. Ecco l’articolo richiesto sulla questione CHAT GPT. Buona lettura

Il nuovo Bing favorito motore di ricerca è in grado di realizzare articoli basati sull’intelligenza artificiale. Ecco l’articolo richiesto sulla questione CHAT GPT. Buona lettura

L’autorità italiana per la protezione dei dati ha annunciato il 31 marzo 2023 il blocco di ChatGPT e l’avvio di un’indagine su OpenAI, la società che ha creato il chatbot. La decisione è stata presa a causa di preoccupazioni sulla privacy e sulla sicurezza dei dati degli utenti123. L’autorità ha citato una violazione dei dati del 20 marzo e l’assenza di una “base legale” per l’utilizzo dei dati delle persone per addestrare il chatbot1. Questo ordine storico segue una lettera aperta di oltre 1.000 persone che chiedevano alle aziende di intelligenza artificiale di sospendere lo sviluppo2.

ChatGPT è stato lanciato da OpenAI lo scorso novembre e può rispondere alle domande utilizzando un linguaggio naturale simile a quello umano. Può anche imitare altri stili di scrittura, utilizzando Internet come database2. Microsoft ha speso miliardi di dollari per esso ed è stato aggiunto a Bing il mese scorso. Ha anche detto che incorporerà una versione della tecnologia nelle sue app Office, tra cui Word, Excel, PowerPoint e Outlook2.

Ci sono state preoccupazioni per i potenziali rischi dell’intelligenza artificiale (AI), tra cui la minaccia ai posti di lavoro e la diffusione di disinformazione e pregiudizi. In precedenza questa settimana figure chiave del settore tecnologico, tra cui Elon Musk, hanno chiesto la sospensione di questi tipi di sistemi AI temendo che la corsa per svilupparli fosse fuori controllo2.

L’autorità italiana ha dichiarato che non solo bloccherà il chatbot di OpenAI ma indagherà anche se rispetta il Regolamento generale sulla protezione dei dati (GDPR). Il GDPR disciplina il modo in cui possiamo utilizzare, elaborare e conservare i dati personali. L’autorità ha dichiarato il 20 marzo che l’app ha subito una violazione dei dati riguardante le conversazioni degli utenti e le informazioni sui pagamenti. Ha detto che non c’era alcuna base legale per giustificare “la raccolta e la conservazione di massa dei dati personali allo scopo di ‘addestrare’ gli algoritmi alla base del funzionamento della piattaforma” 2. Ha anche detto che poiché non c’è modo di verificare l’età degli utenti, l’app “espone i minori a risposte assolutamente inadatte rispetto al loro grado di sviluppo e consapevolezza”2.

OpenAI ha 20 giorni per comunicare le misure che adotterà per conformarsi alle normative italiane sulla protezione dei dati. In caso contrario, potrebbe essere soggetta a una sanzione fino a €20 milioni ($21,8 milioni), o fino al 4% del suo fatturato globale annuo2.

Lascia un commento